《1 前言》

1 前言

随着计算机技术的迅速发展, 模式识别由于其科学应用价值, 在自动化技术、人工智能及各种信息处理的研究领域中受到越来越大的重视

[1 ,2 ,3 ] 。实质上, 模式识别的主要任务是从数据中发现知识, 它要求能从提供的数据中挖掘数据之间的内在联系, 寻找系统的内在规律, 利用优化计算方法, 进行自组织分类或按某种导师要求分类, 因此分类是模式识别的基础, 一旦分类完成了, 机器就可以根据分类进行自动识别了。

模糊中心聚类作为分类的有力工具, 在以模糊逻辑、人工神经网络等为代表的智能计算

[4 ,5 ,6 ,7 ,8 ,9 ] , 在模式识别的研究领域中获得广泛应用, 主要是利用了这些方法在时空数据统计描述的自组织以及一些相互关联的活动中, 自动获取知识功能的非线性映射和聚类特性, 将输入数据通过某种非线性结构映射到输出空间。因此, 模糊中心聚类作为从提供的数据中挖掘数据之间的内在联系, 寻找系统的内在规律的优化计算方法研究, 具有十分重要的理论意义和实用价值。

传统的模糊中心聚类

[4 ,10 ,11 ] 是根据隶属函数MF的面积中心方法计算的, 通过计算每一个输入矢量与中心的距离来实现聚类。存在隶属函数的构建和解模糊化即MF的面积中心的计算工作量的问题。

首先把计算每一个输入矢量与中心的距离来实现聚类作为一个约束情况下的非线性规划问题, 从优化计算的角度推出聚类中心和构造一个模糊隶属函数MF, 然后从递推计算的角度, 提出无导师的递推学习方法来修改模糊聚类中心和隶属函数;最后提出的一种基于模糊中心聚类学习的神经网络来实现并行数据处理和模式分类。

《2 优化计算与模糊中心聚类》

2 优化计算与模糊中心聚类

在模式识别中, 假设输入矢量集X ={X 1 , X 2 , …, X p R p ×s s 个元素, 代表一个矢量的分量, 即 X j x j 1x j 2x js R s

如果要将输入矢量集X ={X 1 , X 2 , …, X p R p ×s c 个类别。反过来说, 输入矢量集中p 个矢量分别属于c 个类别的隶属度可以列成下面的隶属函数矩阵

μ = ⎡ ⎣ ⎢ ⎢ μ 1 1 ⋮ μ c 1 μ 1 2 ⋮ μ c 2 ⋯ ⋯ μ 1 p ⋮ μ c p ⎤ ⎦ ⎥ ⎥ ( 1 ) μ = [ μ 1 1 μ 1 2 ⋯ μ 1 p ⋮ ⋮ ⋮ μ c 1 μ c 2 ⋯ μ c p ] ( 1 )

其中 μ ij i =1, 2, …, c ; j =1, 2, …, p ) 表示第j 个矢量X j i 个类别的隶属度。显然, 每一列表达了第j 个矢量X j c 个类别的隶属度, 它应该满足

∑ i = 1 c μ i j = 1 ‚ j = 1 , 2 , ⋯ , p ‚ 1 ≥ μ i j ≥ 0 ( 2 ) ∑ i = 1 c μ i j = 1 ‚ j = 1 , 2 , ⋯ , p ‚ 1 ≥ μ i j ≥ 0 ( 2 )

模糊聚类的任务是根据输入矢量集X = {X 1 , X 2 , …, X p R p ×s c 个类别的隶属函数矩阵, 或者把输入矢量集X 映射为隶属函数矩阵μ ={μ ij R p ×s μ ={μ ij R p ×s j 个矢量X j c 个类别的隶属度矢量 μ j μ 1j , μ 2j , …, μ cj

定理1 模糊中心聚类方法, 当其聚类中心v i

μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m − 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p 。 μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m - 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p 。

证明 定义模糊聚类中心v i v i 1v i 2v is R s v i i =1, 2, …, c ) 代表每一个聚类在输入空间中的中心矢量, 则第j 个输入矢量X j i 个模糊聚类中心v i

d i j = ∥ v i − X j ∥ = [ ∑ l = 1 s ( v i l − x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 3 ) d i j ≥ 0 。 d i j = ∥ v i - X j ∥ = [ ∑ l = 1 s ( v i l - x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 3 ) d i j ≥ 0 。

J ( X ‚ μ , v ) = ∑ i = 1 c ∑ j = 1 p μ i j m d 2 i j = ∑ i = 1 c ∑ j = 1 p μ i j m ∥ v i − X j ∥ 2 ( 4 ) J ( X ‚ μ , v ) = ∑ i = 1 c ∑ j = 1 p μ i j m d i j 2 = ∑ i = 1 c ∑ j = 1 p μ i j m ∥ v i - X j ∥ 2 ( 4 )

对于输入矢量集X ={X 1 , X 2 , …, X p R p ×s

∑ i = 1 c μ i j = 1 ‚ 1 ≥ μ i j ≥ 0 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 5 ) d i j = ∥ v i j − X j ∥ ‚ d i j ≥ 0 。 ∑ i = 1 c μ i j = 1 ‚ 1 ≥ μ i j ≥ 0 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 5 ) d i j = ∥ v i j - X j ∥ ‚ d i j ≥ 0 。

要求实函数J ( X , μ , v ) = ∑ i = 1 c ∑ j = 1 p μ i j m d 2 i j = ∑ i = 1 c ∑ j = 1 p μ i j m ∥ v i − X j ∥ 2 J ( X , μ , v ) = ∑ i = 1 c ∑ j = 1 p μ i j m d i j 2 = ∑ i = 1 c ∑ j = 1 p μ i j m ∥ v i - X j ∥ 2

L ( X , μ , v ‚ λ ) = J ( X , μ , v ) + ∑ j = 1 p λ j ( 1 − ∑ i = 1 c μ i j ) ( 6 ) L ( X , μ , v ‚ λ ) = J ( X , μ , v ) + ∑ j = 1 p λ j ( 1 - ∑ i = 1 c μ i j ) ( 6 )

式中 λ = (λ 1 , λ 2 , …, λ p T ∈ R 是Lagrange乘数算子。

∂ J ( X , μ ‚ v ) ∂ v i + ∑ j = 1 p λ i j ∂ ∂ v i ( 1 − ∑ i = 1 c μ i j ) = 0 ( 7 ) ∂ J ( X , μ ‚ v ) ∂ v i + ∑ j = 1 p λ i j ∂ ∂ v i ( 1 - ∑ i = 1 c μ i j ) = 0 ( 7 )

v i = ∑ j = 1 p μ i j m X j / ∑ j = 1 p μ i j m ‚ i = 1 , 2 , ⋯ , c ( 8 ) v i = ∑ j = 1 p μ i j m X j / ∑ j = 1 p μ i j m ‚ i = 1 , 2 , ⋯ , c ( 8 )

∂ J ( X , μ , v ) ∂ μ i j + ∑ j = 1 p λ i j ∂ ∂ μ i j ( 1 − ∑ i = 1 c μ i j ) = 0 ( 9 ) ∂ J ( X , μ , v ) ∂ μ i j + ∑ j = 1 p λ i j ∂ ∂ μ i j ( 1 - ∑ i = 1 c μ i j ) = 0 ( 9 )

μ i j = ( λ / m d 2 i j ) 1 / ( m − 1 ) ‚ i = 1 , 2 , ⋯ , c ( 1 0 ) μ i j = ( λ / m d i j 2 ) 1 / ( m - 1 ) ‚ i = 1 , 2 , ⋯ , c ( 1 0 )

∑ k = 1 c μ k j = ∑ k = 1 c ( λ / m d 2 k j ) 1 / ( m − 1 ) = λ 1 / ( m − 1 ) ∑ i = 1 c ( 1 / m d 2 k j ) 1 / ( m − 1 ) ( 1 1 ) ∑ k = 1 c μ k j = ∑ k = 1 c ( λ / m d k j 2 ) 1 / ( m - 1 ) = λ 1 / ( m - 1 ) ∑ i = 1 c ( 1 / m d k j 2 ) 1 / ( m - 1 ) ( 1 1 )

由约束条件∑ k = 1 c μ k j = 1 ∑ k = 1 c μ k j = 1

λ 1 / ( m − 1 ) = 1 / ∑ k = 1 c ( 1 / m d 2 k j ) 1 / ( m − 1 ) ( 1 2 ) λ 1 / ( m - 1 ) = 1 / ∑ k = 1 c ( 1 / m d k j 2 ) 1 / ( m - 1 ) ( 1 2 )

μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m − 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 1 3 ) μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m - 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , p ( 1 3 )

为了计算第j 个矢量X j 分别属于c 个类别的隶属度矢量μ j μ 1j , μ 2j , …, μ cj j 个输入矢量X j i 个模糊聚类中心v i d ij v i X j v i v i μ ij j 个矢量X j c 个类别的隶属度矢量μ j v i

推论1 模糊中心聚类可由无导师在线学习实现, 其聚类中心v i = ∑ j = 1 p μ i j m X j / ∑ j = 1 p μ i j m v i = ∑ j = 1 p μ i j m X j / ∑ j = 1 p μ i j m v i n +1) =v i n ) + η i n +1) · (X n +1v i n ) ) , i =1, 2, …, c 进行, 其中η i ( n + 1 ) = μ i , n + 1 m / ∑ j = 1 n + 1 μ i j m η i ( n + 1 ) = μ i , n + 1 m / ∑ j = 1 n + 1 μ i j m n +1输入矢量时, 递归计算过程中的一个动态常数。

证明 根据式 (8) , 设n (1≤n ≤p ) 输入矢量时的模糊聚类中心为

v i ( n ) = ∑ j = 1 n μ i j m X j / ∑ j = 1 n μ i j m ‚ i = 1 , 2 , ⋯ , c ( 1 4 ) v i ( n ) = ∑ j = 1 n μ i j m X j / ∑ j = 1 n μ i j m ‚ i = 1 , 2 , ⋯ , c ( 1 4 )

μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m − 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n ( 1 5 ) μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m - 1 ) ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n ( 1 5 )

d i j = ∥ v i − X j ∥ = [ ∑ l = 1 s ( v i l − x j l ) 2 ] 1 / 2 ( 1 6 ) d i j = ∥ v i - X j ∥ = [ ∑ l = 1 s ( v i l - x j l ) 2 ] 1 / 2 ( 1 6 )

定义第n +1 (1≤n ≤p ) 输入矢量时的模糊聚类中心为

v i ( n + 1 ) = ∑ j = 1 n + 1 μ i j m X j / ∑ j = 1 n + 1 μ i j m ‚ i = 1 , 2 , ⋯ , c ( 1 7 ) v i ( n + 1 ) = ∑ j = 1 n + 1 μ i j m X j / ∑ j = 1 n + 1 μ i j m ‚ i = 1 , 2 , ⋯ , c ( 1 7 )

v i ( n + 1 ) = ∑ j = 1 n + 1 μ i j m X j / ∑ j = 1 n + 1 μ i j m = ( ∑ j = 1 n μ i j m X j + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m ( 1 8 ) v i ( n + 1 ) = ∑ j = 1 n + 1 μ i j m X j / ∑ j = 1 n + 1 μ i j m = ( ∑ j = 1 n μ i j m X j + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m ( 1 8 )

v i ( n + 1 ) = ( v i ( n ) ∑ j = 1 n μ i j m + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = ( v i ( n ) ( ∑ j = 1 n + 1 μ i j m − μ i , n + 1 m ) + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = ( v i ( n ) ∑ j = 1 n + 1 μ i j m − v i ( n ) μ i n + 1 m + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = v i ( n ) + μ i , n + 1 m ( X n + 1 − v i ( n ) ) / ∑ j = 1 n + 1 μ i j m ( 1 9 ) v i ( n + 1 ) = ( v i ( n ) ∑ j = 1 n μ i j m + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = ( v i ( n ) ( ∑ j = 1 n + 1 μ i j m - μ i , n + 1 m ) + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = ( v i ( n ) ∑ j = 1 n + 1 μ i j m - v i ( n ) μ i n + 1 m + μ i , n + 1 m X n + 1 ) / ∑ j = 1 n + 1 μ i j m = v i ( n ) + μ i , n + 1 m ( X n + 1 - v i ( n ) ) / ∑ j = 1 n + 1 μ i j m ( 1 9 )

令第n +1输入矢量时, 递归计算过程中的一个动态常数为

η i ( n + 1 ) = μ i ‚ n + 1 m / ∑ j = 1 n + 1 μ i j m , i = 1 , 2 , ⋯ , c ( 2 0 ) η i ( n + 1 ) = μ i ‚ n + 1 m / ∑ j = 1 n + 1 μ i j m , i = 1 , 2 , ⋯ , c ( 2 0 )

v i ( n + 1 ) = v i ( n ) + η i ( n + 1 ) ( X n + 1 − v i ( n ) ) , i = 1 , 2 , ⋯ , c ( 2 1 ) v i ( n + 1 ) = v i ( n ) + η i ( n + 1 ) ( X n + 1 - v i ( n ) ) , i = 1 , 2 , ⋯ , c ( 2 1 )

根据上述递归计算公式, 在线学习确定模糊聚类中心v i μ = {μ ij

Step 1 用 (0, 1) 之间的随机数初始化1, 2, …, c 各个输入向量的隶属函数μ ( 1 ) ( 0 ) ( 0 ) ( 1 ) μ 1i (0) , μ 2i (0) , …, μ ij (0) ) , i =1, 2, …, c , 需要划分为多少个类别, 第一次就要初始化多少个向量, 并且这些向量不能相同, 还要注意到约束条件∑ i = 1 c μ i 1 ( 0 ) = 1 ∑ i = 1 c μ i 1 ( 0 ) = 1 k =0, n =c 。先计算一个模糊聚类中心:v i ( k ) ( n ) = ∑ j = 1 n μ i j m ( k ) X k / ∑ j = 1 n μ i j m ( k ) ‚ i = 1 , 2 , ⋯ , c v i ( k ) ( n ) = ∑ j = 1 n μ i j m ( k ) X k / ∑ j = 1 n μ i j m ( k ) ‚ i = 1 , 2 , ⋯ , c

Step 2 令n =n +1, 计算第n 个输入矢量的隶属函数:

μ i j ( k ) = 1 / ∑ k = 1 c ( d i j ( k ) / d k j ( k ) ) 2 / ( m − 1 ) ‚ μ i j ( k ) = 1 / ∑ k = 1 c ( d i j ( k ) / d k j ( k ) ) 2 / ( m - 1 ) ‚

其中d i j = ∥ v i − X j ∥ = [ ∑ l = 1 s ( v i l − x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n d i j = ∥ v i - X j ∥ = [ ∑ l = 1 s ( v i l - x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n

Step 3 计算η i ( k ) ( n + 1 ) = μ i ‚ n + 1 2 ( k ) ( n ) / ∑ j = 1 n + 1 μ i j 2 ( k ) ( n ) η i ( k ) ( n + 1 ) = μ i ‚ n + 1 2 ( k ) ( n ) / ∑ j = 1 n + 1 μ i j 2 ( k ) ( n )

v ( k ) ( n + 1 ) = v i ( k ) ( n ) + η i ( k ) ( n + 1 ) ⋅ ( X n + 1 − v i ( k ) ( n ) ) , i = 1 , 2 , ⋯ , c 。 v ( k ) ( n + 1 ) = v i ( k ) ( n ) + η i ( k ) ( n + 1 ) ⋅ ( X n + 1 - v i ( k ) ( n ) ) , i = 1 , 2 , ⋯ , c 。

Step 4 根据v (k ) (n ) , 计算n 个输入矢量的隶属函数:

μ i j ( k ) ( n + 1 ) = 1 / ∑ k = 1 c ( d i j ( k ) / d k j ( k ) ) 2 / ( m − 1 ) ‚ μ i j ( k ) ( n + 1 ) = 1 / ∑ k = 1 c ( d i j ( k ) / d k j ( k ) ) 2 / ( m - 1 ) ‚

其中d i j = ∥ v i − X j ∥ = [ ∑ l = 1 s ( v i l − x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n d i j = ∥ v i - X j ∥ = [ ∑ l = 1 s ( v i l - x j l ) 2 ] 1 / 2 ‚ i = 1 , 2 , ⋯ , c , j = 1 , 2 , ⋯ , n

Step 5 当n =p 时, 计算隶属度函数矩阵 |μ (k +1) (n ) -μ (k ) (n ) | 是否小于ε, ε是一个预定的小的正实数误差值。如果小于ε, 计算停止, 得到要求的模糊聚类中心v i μ ={μ ij ε , 令k =k +1, 并令v i (k ) (n ) =v i (k +1) (0) 转到Step 2。

《3 模糊中心聚类仿真结果》

3 模糊中心聚类仿真结果

模糊中心聚类通过计算每个输入矢量与中心的距离来完成的。

用IRIS

[12 ] 数据作为算法的验证数据, 因为IRIS数据是国际公认的比较无监督分类 (聚类) 方法效果好坏的典型数据。它包含了150个4维的样本点, 聚类类别数c =3, 每一类各50个样本点, 第一类序号为1—50, 第二类序号为51—100, 第三类序号为101—150。

实验中, 给定了迭代次数上限T max , 如果2次迭代隶属函数矩阵的数值之差小于给定的误差ε , 将视为收敛并终止迭代。初始中心点是在样本集合范围内随机选取, 并要求不同。当c =3, m =2, T max =20, ε =10-6 时, 得到模糊中心聚类递推学习方法的聚类结果为第一类正确分类。第二类的58, 59分到第一类, 55, 56, 59, 64, 65, 69, 71, 73, 74, 77, 78, 79, 84, 87, 88, 90, 91, 92分到第三类。第三类正确分类, 总共错分了20个数, 错分率为13.3 %。图1为目标函数值随迭代次数变化的曲线, 由图1可见, 当迭代次数超过一定值, 目标函数J (X , μ , v ) 接近极小值。图2为数据分类的结果, ‘*’, ‘。' 和‘×' 分别代表3类数, 图2中只画出每个数据X i X 1 , X 2 , X 3 , X 4 } (i =1, 2, …, 150) 的3维向量X 1 , X 2 , X 3 。

《图1》

图1 目标函数值随迭代次数变化的曲线 Fig.1 A change curve of clustering objective function

《图2》

图2 c =3时IRIS数据的分类结果 Fig.2 The results of fuzzy central clustering of IRIS data (c =3)

《4 模糊中心聚类模式识别神经网络》

4 模糊中心聚类模式识别神经网络

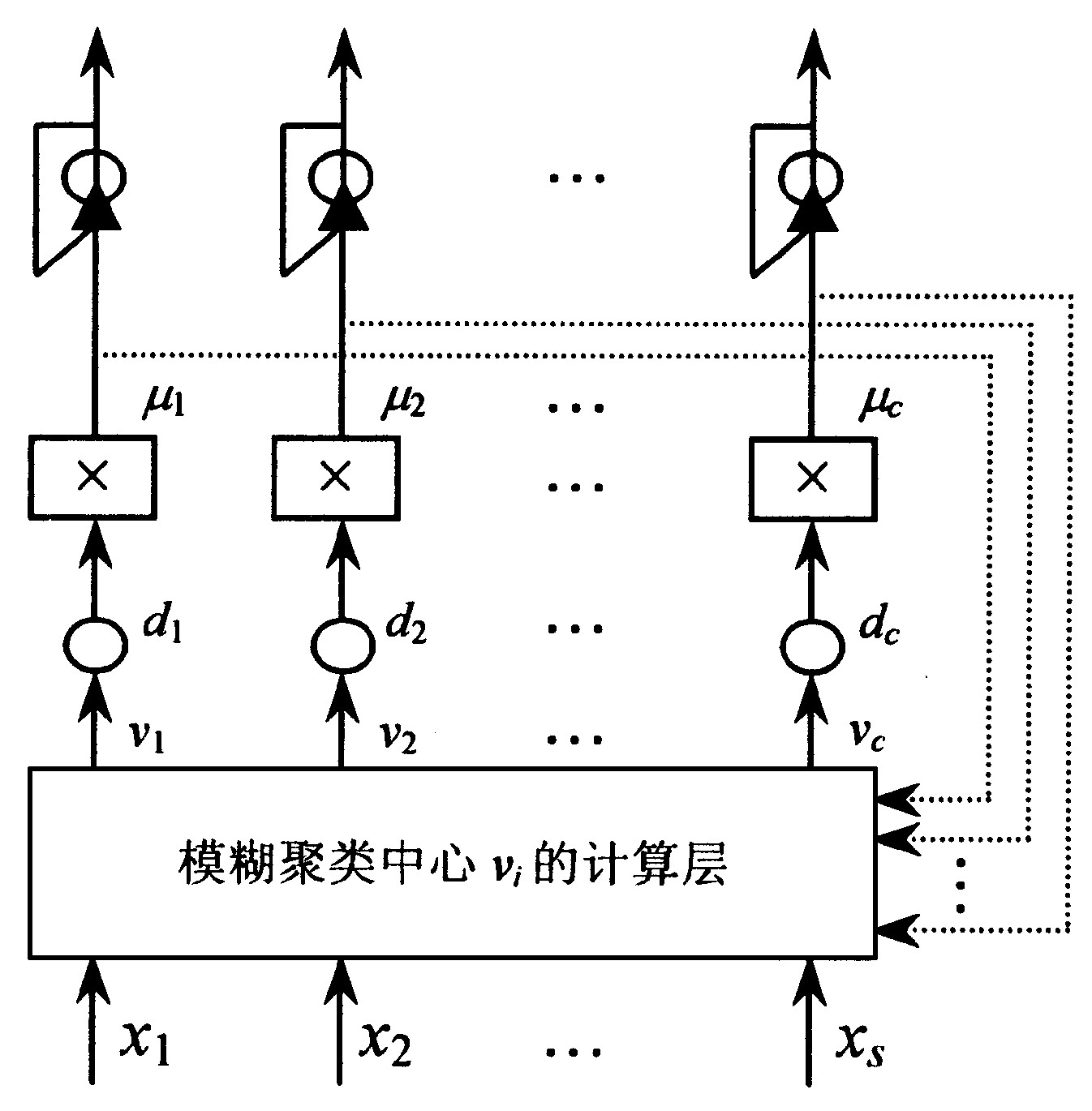

提出的模糊中心聚类方法易于网络结构实现, 网络便于并行计算实施。在该网络的输出端加上一个正反馈硬划分结构, 就构成一个模糊中心聚类模式识别神经网络。其结构示意图见图3。

《图3》

图3 模糊中心聚类模式识别神经网络实现 Fig.3 The model of fuzzy central clustering neural network

该网络的最后一层就是为实现模式分类为硬划分而设计的一个正反馈硬划分结构, 它把第j个输入矢量X j x j 1x j 2x js μ j μ 1j , μ 2j , …, μ cj

网络的第三层是输出隶属函数矢量μ j μ 1j , μ 2j , …, μ cj d i j = ∥ v i − X j ∥ = [ ∑ l = 1 s ( v i l − x j l ) 2 ] 1 / 2 d i j = ∥ v i - X j ∥ = [ ∑ l = 1 s ( v i l - x j l ) 2 ] 1 / 2 μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m − 1 ) μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m - 1 )

网络第二层是距离函数计算层, 它将输入矢量X j v i v i 1v i 2v is i =1, 2, …, c , 分别计算第j 个输入矢量X j i 个模糊聚类中心v i

网络第一层是模糊聚类中心v i ∑ j = 1 n μ i j m ∑ j = 1 n μ i j m ∑ j = 1 n μ i j m X j ∑ j = 1 n μ i j m X j v i = ∑ j = 1 n μ i j m X j / ∑ j = 1 n μ i j m v i = ∑ j = 1 n μ i j m X j / ∑ j = 1 n μ i j m

利用上节推出的无导师在线递推学习确定模糊聚类中心v i μ = {μ ij μ = {μ ij v i

《5 结语》

5 结语

从优化计算的角度研究了模式识别中广泛应用的模糊中心聚类问题, 首先把计算每一个输入矢量与中心的距离来实现聚类作为一个约束情况下的非线性规划问题, 证明了模糊中心聚类方法, 取一个适当的隶属函数μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m − 1 ) ‚ i = 1 , 2 , ⋯ , c μ i j = 1 / ∑ k = 1 c ( d i j / d k j ) 2 / ( m - 1 ) ‚ i = 1 , 2 , ⋯ , c j =1, 2, …, p , 其聚类中心v i

京公网安备 11010502051620号

京公网安备 11010502051620号